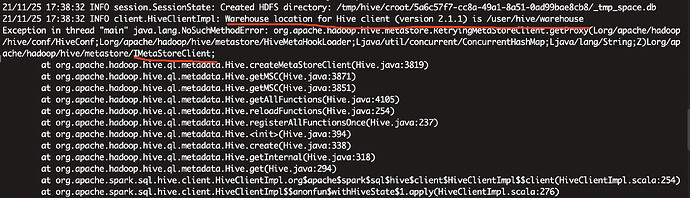

使用mysql 导入数据 为什么会报 hive 异常呢

config文件

{

# Spark 相关配置

spark: {

app: {

name: Nebula Exchange 2.6.1

}

driver: {

cores: 1

maxResultSize: 1G

}

cores {

max: 16

}

}

# Nebula Graph 相关配置

nebula: {

address:{

graph:["10.*.7.*:9669", "10.*.7.*:9669", "10.*.7.*:9669"]

meta:["10.*.7.*:9559", "10.*.7.*:9559", "10.*.7.*:9559"]

}

# 填写的账号必须拥有 Nebula Graph 相应图空间的写数据权限。

user: root

pswd: 123

# 填写 Nebula Graph 中需要写入数据的图空间名称。

space: my_xiao_mi

connection {

timeout: 3000

retry: 3

}

execution {

retry: 3

}

error: {

max: 32

output: /tmp/errors

}

rate: {

limit: 1024

timeout: 1000

}

}

# 处理点

tags: [

# 设置 Tag player 相关信息。

{

# Nebula Graph 中对应的 Tag 名称。

name: Person

type: {

# 指定数据源文件格式,设置为 MySQL。

source: mysql

# 指定如何将点数据导入 Nebula Graph:Client 或 SST。

sink: client

}

host:10.*.7.*

port:3306

database:"lgsbiz_test"

table:"bas_addressee"

user:"lgsbiz_sf_test"

password:"aB3lv78AxL5R"

sentence:"select name,bas_id,phone from lgsbiz_test.bas_addressee where DATE_FORMAT(creation_time, '%Y-%m-%d') ='2019-05-17';"

# 在 fields 里指定 player 表中的列名称,其对应的 value 会作为 Nebula Graph 中指定属性。

# fields 和 nebula.fields 里的配置必须一一对应。

# 如果需要指定多个列名称,用英文逗号(,)隔开。

fields: [name,bas_id,phone]

nebula.fields: [name,c_no,phone]

# 指定表中某一列数据为 Nebula Graph 中点 VID 的来源。

vertex: {

field:bas_id

}

# 单批次写入 Nebula Graph 的数据条数。

batch: 256

# Spark 分区数量

partition: 32

}

# 设置 Tag team 相关信息。

{

name: Phone

type: {

source: mysql

sink: client

}

host:10.*.7.*

port:3306

database:"lgsbiz_test"

table:"bas_addressee"

user:"lgsbiz_sf_test"

password:"aB3lv78AxL5R"

sentence:"select phone from lgsbiz_test.bas_addressee where DATE_FORMAT(creation_time, '%Y-%m-%d') ='2019-05-17';"

fields: [phone]

nebula.fields: [phone]

vertex: {

field: phone

}

batch: 256

partition: 32

}

]

# 处理边数据

edges: [

# 设置 Edge type follow 相关信息

{

# Nebula Graph 中对应的 Edge type 名称。

name: LIKES

type: {

# 指定数据源文件格式,设置为 MySQL。

source: mysql

# 指定边数据导入 Nebula Graph 的方式,

# 指定如何将点数据导入 Nebula Graph:Client 或 SST。

sink: client

}

host:10.*.7.*

port:3306

database:"lgsbiz_test"

table:"bas_addressee"

user:"lgsbiz_sf_test"

password:"aB3lv78AxL5R"

sentence:"select phone,bas_id ,creation_time from lgsbiz_test.bas_addressee where DATE_FORMAT(creation_time, '%Y-%m-%d') ='2019-05-17';"

# 在 fields 里指定 follow 表中的列名称,其对应的 value 会作为 Nebula Graph 中指定属性。

# fields 和 nebula.fields 里的配置必须一一对应。

# 如果需要指定多个列名称,用英文逗号(,)隔开。

fields: [creation_time]

nebula.fields: [creationDate]

# 在 source 里,将 follow 表中某一列作为边的起始点数据源。

# 在 target 里,将 follow 表中某一列作为边的目的点数据源。

source: {

field: bas_id

}

target: {

field: phone

}

# 单批次写入 Nebula Graph 的数据条数。

batch: 256

# Spark 分区数量

partition: 32

}

# 设置 Edge type serve 相关信息

{

name: USE

type: {

source: mysql

sink: client

}

host:10.*.7.*

port:3306

database:"lgsbiz_test"

table:"bas_addressee"

user:"lgsbiz_sf_test"

password:"aB3lv78AxL5R"

sentence:"select phone,bas_id from lgsbiz_test.bas_addressee where DATE_FORMAT(creation_time, '%Y-%m-%d') ='2019-05-17';"

fields: [-]

nebula.fields: [-]

source: {

field: bas_id

}

target: {

field: phone

}

batch: 256

partition: 32

}

]

}