- nebula 版本:nebula1.x……具体哪个版本已经记不太清了

- 部署方式:Docker

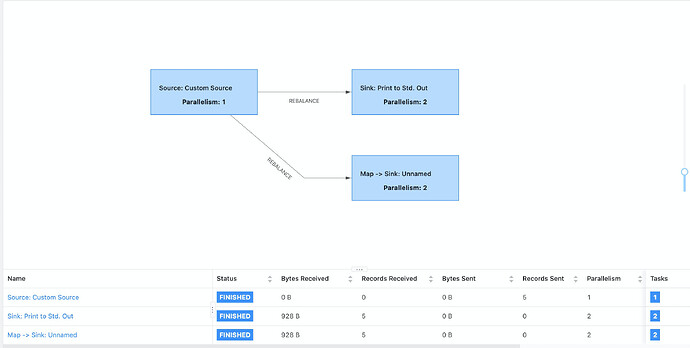

- 问题的具体描述:尝试通过flink来读取写入数据,但是好像报一个.so找不到的错误,在本地和服务器上都试过不太好使,

maven依赖:

<dependency>

<artifactId>nebula-flink</artifactId>

<groupId>com.vesoft</groupId>

<version>${nebula.version}</version>

</dependency>

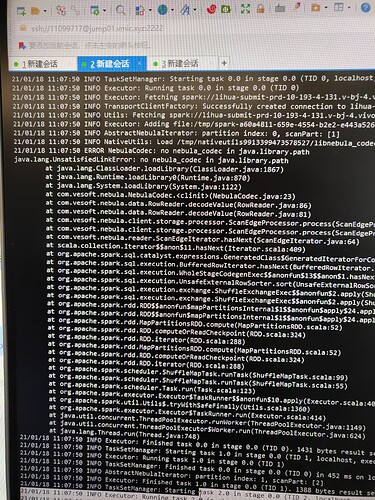

报错日志如下:

2020-12-17 17:08:10,753 INFO com.vesoft.nebula.utils.NativeUtils - Load /tmp/nativeutils1220502106376336/libnebula_codec.so as libnebula_codec.so

2020-12-17 17:08:10,784 ERROR com.vesoft.nebula.NebulaCodec - no nebula_codec in java.library.path

java.lang.UnsatisfiedLinkError: no nebula_codec in java.library.path

at java.lang.ClassLoader.loadLibrary(ClassLoader.java:1867)

at java.lang.Runtime.loadLibrary0(Runtime.java:870)

at java.lang.System.loadLibrary(System.java:1122)

at com.vesoft.nebula.NebulaCodec.<clinit>(NebulaCodec.java:23)

at com.vesoft.nebula.data.RowReader.decodeValue(RowReader.java:86)

at com.vesoft.nebula.data.RowReader.decodeValue(RowReader.java:81)

at com.vesoft.nebula.client.storage.processor.ScanVertexProcessor.process(ScanVertexProcessor.java:61)

at com.vesoft.nebula.client.storage.processor.ScanVertexProcessor.process(ScanVertexProcessor.java:26)

at org.apache.flink.connector.nebula.source.NebulaInputFormat.open(NebulaInputFormat.java:131)

at org.apache.flink.runtime.operators.DataSourceTask.invoke(DataSourceTask.java:173)

at org.apache.flink.runtime.taskmanager.Task.doRun(Task.java:705)

at org.apache.flink.runtime.taskmanager.Task.run(Task.java:530)

at java.lang.Thread.run(Thread.java:745)

2020-12-17 17:08:11,145 INFO org.apache.flink.connector.nebula.source.NebulaInputFormat - Closing split (scanned 3 rows)